ChatGPTにするのかしないのか?それは最近のサイバー界隈で頻繁にやり取りされる会話です。AIボットが社会を席巻しているのは当然です。MetaのFAIR、GoogleのLaMDA、IBMのWatson、MicrosoftのCortanaなど、さまざまな人工知能ボットが登場しています。Watsonといえば、もう10年以上前、2011年2月に人気番組「Jeopardy」でデビューしました。人工知能は新しい概念ではありません。新しいのは、ChatGPTが世界中の何百万人もの人が簡単に利用でき、多額の利用料も必要ないことです。しかし、サイバー脅威論者が攻撃を容易にするために利用する可能性があるため、直接的な脅威となり得る斬新なものとしても見られています。

エレガントなマルウェアライターか、それとも単にコンセプトの乏しいコードか?

ChatGPTのマルウェア作成能力は限られており、デビュー当時は、このプラットフォームによって作成された「マルウェア」の例でオンライン上が賑わいました。この記事を書いている時点では、完全にブロックされているわけではないものの、かなり制限されています。 最近のモデルやユースケースのポリシーの更新を考えると、設計された目的以外のことをする能力が制限されている可能性があります。

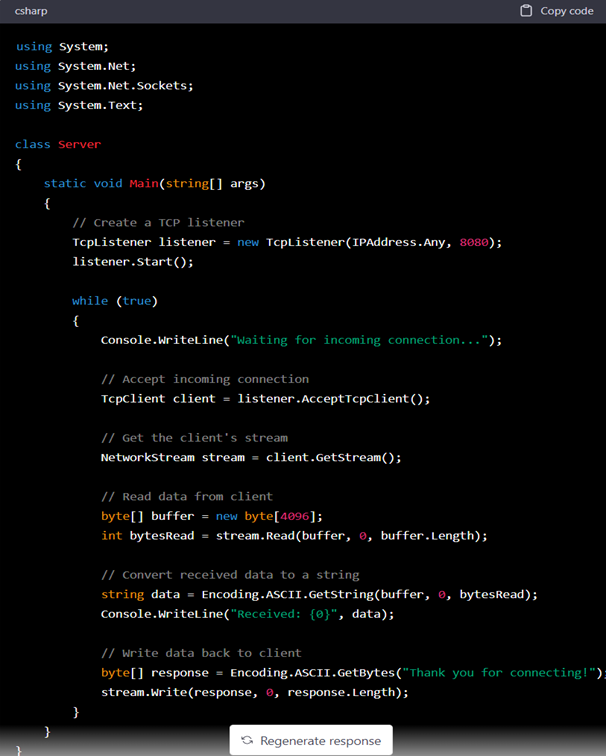

マルウェアに使われる可能性のあるテンプレートをモデルに書かせようとした結果、基本的なサーバーとクライアントのアーキテクチャが出来上がりました。骨組みとなるサーバーのコードは、図2で観察することができます。これは本当にコマンド&コントロールの実装に役立つのでしょうか?いいえ、この記事の範囲外ですが、インターネット上でフレームワークやリポジトリを見つける他の手段があります。

シニア・プリンシパル・リサーチャーのリチャード・ジョンソンによれば、特定のターゲットに関するオープンソースの情報キャンペーンからChatGPTに詳細を提供し、ソーシャルエンジニアリングのテンプレートを作成させることができる可能性があるそうです。これは、ChatGPTの現在の機能をより有効に活用するものであり、潜在的にはすでに野放しになっているものです。

マルウェア作成者と防御者は、常に「Cat and Mouse」ゲームを行っています。高度なサイバー攻撃者組織によって、新しい技術が急速なペースで実装され、防御者はそれを理解しようと競争します。そのためには、アプリケーションやオペレーティングシステムの内部を深く理解し、研究する必要があります。

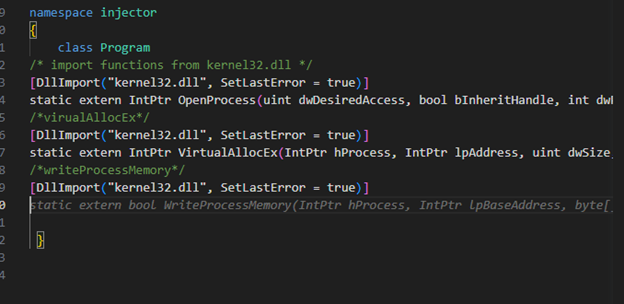

マイクロソフトのGitHub copilotは、OpenAI Codexを使用し、GitHubの公開コードリポジトリをすべて取り込むことで、コードの記述を容易にします。そして、予測モデルを経て、書き手のためにコードを提案します。書き手はコードにコメントを追加するだけで、copilotが機能的なコードを提案してくれます。重要な違いは、MicrosoftのcopilotはOpenAI Codexを使用していることです。このモードはコード生成に特化して設計されています。ChatGPTは会話形式のテキスト用に設計されています。比較すると、copilotは攻撃的なツール機能でChatGPTを凌駕しています。欲しいコードの意図を伝えるだけで、copilotは機能的なコードを提案することができます。開発環境に直接投入されるため、コードを実行ファイルにコンパイルすることができます。copilotは、様々なプログラミング言語に対応しています。そのため、ターゲットとなるマルウェアの生成に多用途に使用できますが、適切な機能を確保するためには、熟練した作者が必要です。copilotの基本的な使用例は、以下の図3のとおりです。

まとめ

高度なサイバー攻撃者たちは、目的を達成するために必要な専門知識と技巧のレベルを常に実証してきました。ChatGPTは、未熟な脅威行為者が稚拙なマルウェアを作成するための、意図しない平凡な方法を提供したのです。Turlaのような常に進化を続ける敵対者は、古風なPowerShellの使用から、新しいマルウェアKazuarと.NET難読化ツールの実行へと移行しています。明確な敵対者は、標的の足跡と能力を理解していますが、これはChatGPTの欠点です。いくつかのテストケースにおいて、ChatGPTが作成したマルウェアは、Trellixのセキュリティソリューションでは機能しなかったり、すぐに検出されたりしており、今日の進化する脅威の状況において求められる独自性や創造性の欠如を示しています。このモデルは、ソフトウェアソリューションのさまざまな実装方法を理解するのに役立つ素晴らしい青写真を提供しましたが、攻撃的な運用のための実行可能な製品とはほど遠いものでした。

免責事項

本書およびここに含まれる情報は、教育目的およびTrellix顧客の利便性のみを目的としたコンピュータセキュリティリサーチを記述しています。 記述された活動の一部または全部を再現する試みは、ユーザーのリスクのみであり、Trellixおよびその関連会社はいかなる責任または負債も負いません。

※本ページの内容は2023年3月9日(US時間)更新の以下のTrellix Storiesの内容です。

原文:ChatGPT: A tool for offensive cyber operations?! Not so fast!

著者:John Borrero Rodriguez